Des chercheurs australiens découvrent une « armée de bots » anti-russe massive

Une université australienne a mis au jour des millions de tweets émis par de faux comptes « robots » diffusant des informations erronées sur la guerre en Ukraine.

Une équipe de chercheurs de l’université d’Adélaïde a découvert que jusqu’à 80 % des tweets relatifs à l’invasion russo-ukrainienne de 2022 au cours des premières semaines faisaient partie d’une campagne de propagande secrète provenant de faux comptes « bot » automatisés.

Une campagne de propagande anti-Russie provenant d’une « armée de robots » de faux comptes Twitter automatisés a inondé l’internet au début de la guerre. Les recherches montrent que sur les plus de 5 millions de tweets étudiés, 90,2 % de tous les tweets (robots et non robots) provenaient de comptes pro-Ukraine, moins de 7 % des comptes étant classés comme pro-russes.

Les chercheurs de l’université ont également découvert que ces tweets automatisés avaient été utilisés à dessein pour susciter la peur chez les personnes ciblées, en augmentant un niveau élevé d' »angoisse » statistiquement mesurable dans le discours en ligne.

L’équipe de recherche a analysé un nombre sans précédent de 5 203 746 tweets, envoyés avec des hashtags clés, au cours des deux premières semaines de l’invasion russe en Ukraine, à partir du 24 février de cette année. Les chercheurs ont pris en compte les comptes de langue anglaise, avec un calcul de 1,8 million de comptes Twitter uniques dans l’ensemble de données postant au moins un tweet en anglais.

Les résultats ont été publiés en août dans un document de recherche intitulé « #IStandWithPutin versus #IStandWithUkraine : The interaction of bots and humans in discussion of the Russia/Ukraine war », par la School of Mathematical Science de l’Université d’Adélaïde.

La taille de l’échantillon étudié, de plus de 5 millions de tweets, éclipse les autres études récentes sur la propagande secrète dans les médias sociaux autour de la guerre en Ukraine.

La recherche peu médiatisée de l’université de Stanford/Graphika sur la désinformation occidentale, analysée par Declassified Australia en septembre, a examiné un peu moins de 300 000 tweets provenant de 146 comptes Twitter. La recherche Meta/Facebook sur la désinformation russe, largement diffusée par les médias grand public, y compris l’ABC deux semaines plus tard, a examiné 1 600 comptes Facebook.

Des rapports sur la nouvelle recherche sont apparus sur quelques sites de médias indépendants, et dans la RT russe, mais pas beaucoup d’autres, révélant ainsi l’enterrement des histoires qui ne correspondent pas au récit pro-occidental souhaité.

Cette étude révolutionnaire, qui expose une campagne massive de désinformation anti-russe sur les médias sociaux, a été efficacement ignorée par les grands médias occidentaux. C’est devenu presque une routine pendant la guerre Russie-Ukraine.

La guerre éclair de la désinformation

Les chercheurs de l’université d’Adélaïde ont mis au jour une vaste opération d’influence organisée en faveur de l’Ukraine dès les premières phases du conflit. Dans l’ensemble, l’étude a révélé que des comptes « robots » automatisés étaient à l’origine de 60 à 80 % de tous les tweets de l’ensemble de données.

Les données publiées montrent qu’au cours de la première semaine de la guerre entre l’Ukraine et la Russie, les robots pro-ukrainiens ont été très actifs. Environ 3,5 millions de tweets utilisant le hashtag #IStandWithUkraine ont été envoyés par des bots au cours de cette première semaine.

En fait, c’est comme si quelqu’un avait appuyé sur un interrupteur, lorsqu’au début de la guerre, le 24 février, l’activité des robots pro-Ukraine a soudainement explosé. Le premier jour de la guerre, le hashtag #IStandWithUkraine a été utilisé dans 38 000 tweets par heure, puis dans 50 000 tweets par heure au troisième jour de la guerre.

À titre de comparaison, les données montrent qu’au cours de la première semaine, l’activité des robots pro-russes utilisant les principaux hashtags a été quasiment nulle. Au cours de cette première semaine d’invasion, les robots pro-russes ont envoyé des tweets utilisant les hashtags #IStandWithPutin ou #IStandWithRussia à un rythme de quelques centaines par heure seulement.

Graphique montrant la fréquence horaire des hashtags « StandWith » sélectionnés. Le hashtag anti-Russie #IStandWithUkraine poussé principalement par des bots automatisés a inondé Twitter au cours de la première semaine de l’invasion russe en Ukraine. (Image : Université d’Adélaïde)

Compte tenu de l’apparente planification à long terme de l’invasion de l’Ukraine, les cyber experts se sont dits surpris que les réponses russes en matière de cyber et d’Internet soient si tardives. Un chercheur du Centre d’études de sécurité, en Suisse, a déclaré : « Les cyberopérations [pro-russes] que nous avons vues ne sont pas préparées de longue date et semblent plutôt désordonnées ».

Après avoir été apparemment laissé à l’abandon, le hashtag #IStandWithPutin, provenant principalement de bots automatisés, a fini par être lancé une semaine après le début de la guerre. Ce hashtag a commencé à apparaître en plus grand nombre le 2 mars, septième jour de la guerre. Il a atteint 10 000 tweets par heure à deux reprises seulement au cours des deux jours suivants, toujours loin derrière l’activité des tweets pro-Ukraine.

L’utilisation du hashtag #IStandWithRussia était encore plus faible, atteignant seulement 4 000 tweets par heure. Après seulement deux jours de fonctionnement, l’activité du hashtag pro-russe avait presque complètement disparu. Les chercheurs de l’étude ont noté que les comptes robots automatisés, « probablement utilisés par les autorités russes », ont été « supprimés probablement par les autorités pro-ukrainiennes ».

La réaction contre ces comptes pro-russes a été rapide. Le 5 mars, après la diffusion du hashtag #IStandWithPutin sur Twitter, la société a annoncé qu’elle avait banni plus de 100 comptes utilisant le hashtag pour avoir violé sa « politique de manipulation de la plateforme et de spam » et participé à un « comportement inauthentique coordonné ».

Plus tard dans le mois, le service de sécurité ukrainien (SBU) aurait effectué une descente dans cinq « fermes de bots » opérant dans le pays. Les opérateurs de robots liés à la Russie opéraient par le biais de 100 000 faux comptes de médias sociaux diffusant de la désinformation destinée à « semer la panique parmi les masses ukrainiennes ».

La guerre des « armées de robots ». Les forces de sécurité ukrainiennes ont découvert une « armée de bots » pro-russes opérant dans un appartement en mars 2022. Le raid a permis de découvrir 100 jeux de passerelles GSM, à gauche, et 10 000 cartes sim, à droite, permettant de gérer 100 000 faux comptes de bots. (Photos : SBU)

Une recherche non filtrée et indépendante

La recherche historique de l’université d’Adélaïde diffère de ces révélations antérieures d’une autre manière unique et spectaculaire.

Alors que les recherches de Stanford-Graphika et de Meta ont été produites par des chercheurs ayant des liens profonds et durables avec l’État de sécurité nationale américain, les chercheurs de l’université d’Adélaïde sont remarquablement indépendants. L’équipe universitaire est issue de la School of Mathematical Science de l’université. À l’aide de calculs mathématiques, ils ont entrepris de prédire et de modéliser les traits psychologiques des personnes en fonction de leur empreinte numérique.

Contrairement aux ensembles de données sélectionnés et fournis pour les recherches de Stanford/Graphika et de Meta, les données auxquelles l’équipe de l’université d’Adélaïde a eu accès ne provenaient pas de comptes après avoir été détectés pour violation des directives et fermés par Meta ou Twitter.

Joshua Watt est l’un des principaux chercheurs de l’équipe de l’université. Il est candidat au doctorat en mathématiques appliquées et statistiques à l’école des sciences mathématiques de l’université.

Il a expliqué à Declassified Australia que l’équipe a accédé directement à l’ensemble des 5 millions de tweets à partir des comptes Twitter sur Internet en utilisant une licence universitaire donnant accès à l’API de Twitter. L' »interface de programmation d’applications » est un outil logiciel de communication de données qui permet aux chercheurs de récupérer et d’analyser directement les données de Twitter.

Les faux tweets et les comptes robots automatisés n’avaient pas été détectés et supprimés par Twitter avant d’être analysés par les chercheurs, bien que certains aient pu être supprimés lors du balayage effectué par Twitter en mars. Watt a déclaré à Declassified Australia qu’en fait, un grand nombre des comptes robots à l’origine des 5 millions de tweets étudiés sont probablement toujours en activité.

Declassified Australia a contacté Twitter pour lui demander quelles mesures il avait prises pour supprimer les faux comptes zombies identifiés par l’Université d’Adélaïde. L’entreprise n’avait pas répondu au moment de la mise sous presse.

Outil essentiel dans la guerre de l’information

Ce nouveau document de recherche confirme les craintes croissantes que les médias sociaux soient secrètement devenus ce que les chercheurs appellent « un outil essentiel de la guerre de l’information jouant un rôle important dans l’invasion russe de l’Ukraine ».

Les chercheurs de l’université d’Adélaïde ont fait de leur mieux pour ne pas s’engager dans la description des activités des faux comptes Twitter, bien qu’ils aient constaté que la grande majorité – plus de 90 % – était constituée de messages anti-russes. Ils ont déclaré : Les deux parties au conflit ukrainien utilisent l’environnement d’information en ligne pour influencer la dynamique géopolitique et influencer l’opinion publique ».

Ils ont constaté que les deux principales parties participant à la guerre de propagande ont leurs propres objectifs et style particuliers. Les médias sociaux russes mettent en avant des récits sur leur motivation, tandis que les médias sociaux ukrainiens visent à encourager et à maintenir le soutien extérieur des pays occidentaux, ainsi qu’à promouvoir leurs efforts militaires tout en sapant la perception de l’armée russe.

Si les résultats de la recherche se sont concentrés sur les robots Twitter, ils ont également porté sur l’utilisation des hashtags par les tweeteurs non robots. Ils ont constaté des flux d’informations importants en provenance de comptes pro-russes non bots, mais aucun flux important en provenance de comptes pro-Ukraine non bots.

En plus d’être beaucoup plus active, la partie pro-Ukraine s’est avérée beaucoup plus avancée dans son utilisation des bots. Le camp pro-ukrainien a utilisé davantage de « bots astroturf » que les pro-russes. Les bots astroturf sont des bots politiques hyperactifs qui suivent continuellement de nombreux autres comptes afin d’augmenter le nombre d’adeptes de ce compte.

Le rôle des médias sociaux dans le renforcement de la peur

Les chercheurs de l’université d’Adélaïde ont également étudié l’influence psychologique des faux comptes bots automatisés sur les conversations en ligne au cours de ces premières semaines de guerre.

Ces conversations au sein d’un public cible peuvent évoluer au fil du temps vers un soutien ou une opposition à l’égard des gouvernements et des politiques – mais elles peuvent aussi avoir des effets plus instantanés, influençant les décisions immédiates du public cible.

Les nuages de mots pour « angoisse », à gauche, et « mouvement », à droite, montrent la fréquence des mots dans des catégories linguistiques particulières, qui ont été utilisés dans les 5 millions de tweets étudiés. (Image : Université d’Adélaïde)

L’étude a révélé que ce sont les tweets des faux comptes « bot » qui ont le plus contribué à « l’augmentation des conversations sur l’angoisse » parmi les personnes ciblées par ces comptes. Ils ont constaté que ces comptes bots automatisés augmentaient « l’utilisation de mots de la catégorie angoisse, qui contient des mots liés à la peur et à l’inquiétude, tels que « honte », « terroriste », « menace », « panique » ».

En combinant les messages d' »angoisse » avec des messages sur le « mouvement » et les lieux géographiques, les chercheurs ont constaté que « les comptes zombies influencent davantage les discussions sur le fait de bouger/fuir/partir ou rester ». Les chercheurs pensent que cet effet pourrait bien avoir été d’inciter les Ukrainiens, même éloignés des zones de conflit, à fuir leurs maisons.

La recherche montre que les faux comptes automatisés des médias sociaux manipulent l’opinion publique en façonnant le discours, parfois de manière très spécifique. Les résultats donnent une indication effrayante des effets malveillants très réels que les campagnes de désinformation massive sur les médias sociaux peuvent avoir sur une population civile innocente.

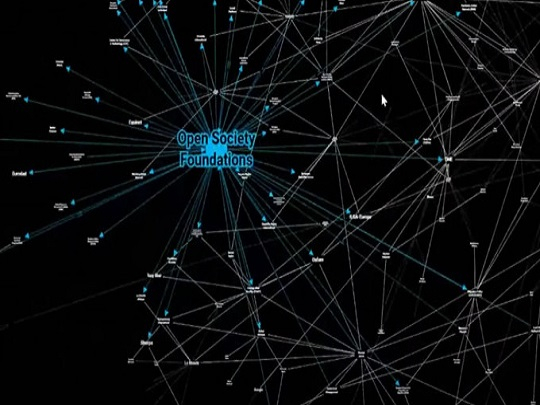

Origines des comptes bots Twitter

Les chercheurs indiquent que la grande majorité de la désinformation anti-russe sur Twitter provient de bots « probablement [organisés] par les autorités pro-ukrainiennes ».

Les chercheurs n’ont pas avancé d’autres conclusions sur l’origine des 5 millions de tweets, mais ont constaté que certains bots « poussent des campagnes spécifiques à certains pays [non nommés], et partagent donc du contenu aligné sur ces fuseaux horaires ». Les données montrent que le pic d’activité d’une sélection de bots pro-ukrainiens se situe entre 18 et 21 heures dans les fuseaux horaires américains.

L’origine et la cible des messages peuvent être déduites des langues spécifiques utilisées dans les 5 millions de tweets. Plus de 3,5 millions de tweets, soit 67 %, étaient en anglais, et moins de 2 % en russe et en ukrainien.

En mai 2022, le directeur de l’Agence de sécurité nationale (NSA) et chef du Cyber Command américain, le général Paul Nakasone, a révélé que le Cyber Command avait mené des opérations d’information offensives en soutien à l’Ukraine.

Nous avons mené une série d’opérations sur l’ensemble du spectre : opérations offensives, défensives, [et] d’information « , a déclaré Nakasone.

Nakasone a déclaré que les Etats-Unis ont mené des opérations visant à démanteler la propagande russe. Il a ajouté que ces opérations étaient légales, menées dans le cadre d’une politique déterminée par le ministère de la défense américain et sous le contrôle d’un organisme civil. M. Nakasone a ajouté que les États-Unis cherchent à dire la vérité lorsqu’ils mènent une opération d’information, contrairement à la Russie.

Le US Cyber Command a déployé en Ukraine une équipe cybernétique « hunt forward » (« chasse en avant ») en décembre pour aider à renforcer les cyberdéfenses et les réseaux ukrainiens contre les menaces actives, en prévision de l’invasion. Une équipe de réponse rapide cybernétique de l’Union européenne nouvellement formée, composée de 12 experts, a rejoint l’équipe du Cyber Command pour rechercher les cybermenaces actives à l’intérieur des réseaux ukrainiens et renforcer les cyberdéfenses du pays.

Les États-Unis ont investi 40 millions de dollars depuis 2017 pour aider l’Ukraine à étayer son secteur des technologies de l’information. Selon la secrétaire d’État adjointe américaine Wendy Sherman, ces investissements ont aidé les Ukrainiens à « garder leur internet allumé et les informations circuler, même au milieu d’une invasion russe brutale ».

Des guerres et des mensonges dans nos poches

Avec l’essor d’Internet, la guerre et les conflits armés ne seront plus jamais les mêmes. D’autres ont noté que l’invasion de l’Ukraine par la Russie a marqué le début d’une « nouvelle ère numérique de conflits militaires, politiques et économiques » manipulés par « des généraux sur ordinateur et des armées de robots ».

« Dans toutes les dimensions de ce conflit, la technologie numérique joue un rôle clé – en tant qu’outil pour les cyberattaques et les protestations numériques, et en tant qu’accélérateur des flux d’information et de désinformation », écrit l’un d’eux.

« La propagande fait partie de la guerre depuis le début de l’histoire, mais jamais auparavant elle n’a pu être aussi largement diffusée au-delà d’une zone de conflit réelle et cibler autant de publics différents ».

Joshua Watt, l’un des principaux chercheurs de l’équipe de l’université d’Adélaïde qui a mené cette étude historique, résume la situation. « Dans le passé, les guerres étaient principalement menées physiquement, les armées, les forces aériennes et les opérations navales étant les principales formes de combat. Cependant, les médias sociaux ont créé un nouvel environnement dans lequel l’opinion publique peut être manipulée à très grande échelle ».

« CNN a amené des guerres autrefois lointaines dans nos salons », a déclaré un autre, « mais TikTok, YouTube et Twitter les ont mises dans nos poches ».

Nous transportons tous avec nous une puissante source d’informations et de médias d’information – et aussi, très certainement, la désinformation qui nous parvient sans relâche d’opérations d’influence menées par des « mauvais acteurs » dont le but est de tromper.

- Source : Actuintel